di MARIA CONCETTA VALENTE

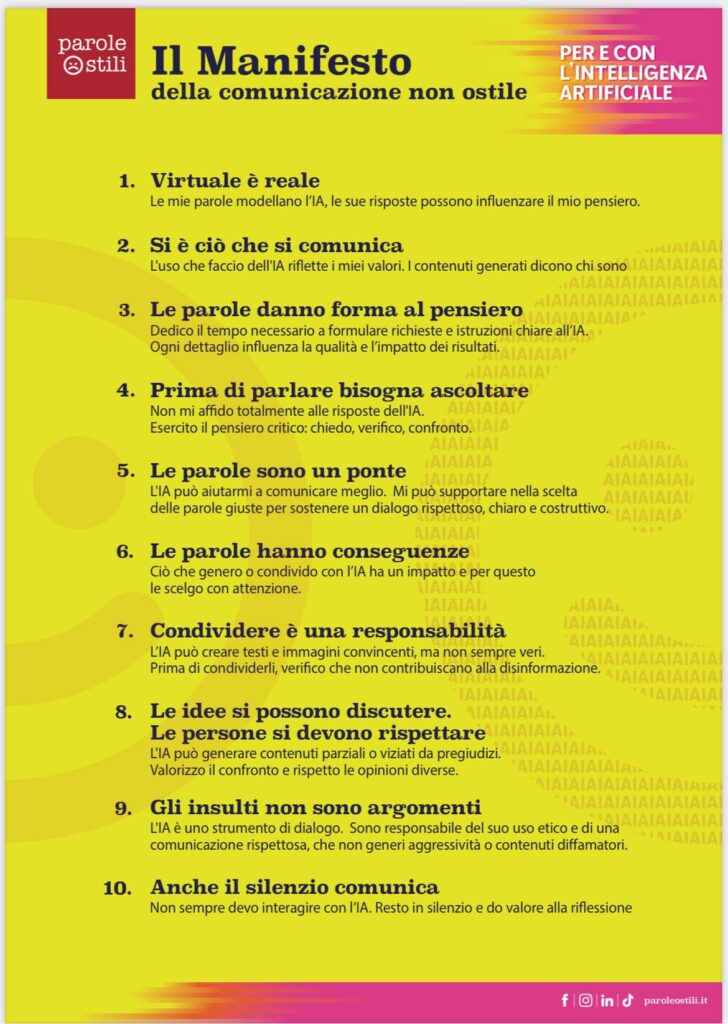

URBINO – “Le mie parole modellano l’IA, le sue risposte possono influenzare il mio pensiero”. “Non mi affido totalmente: chiedo, verifico, confronto”. E ancora: “L’IA è uno strumento di dialogo. Sono responsabile del suo uso etico”. Questi tre princìpi sono stati scritti a “quattro mani” dall’intelligenza artificiale e dagli studenti dell’H-Farm College. Fanno parte del Manifesto della comunicazione non ostile declinato per e con l’IA. Un “aggiornamento” dell’originario formulato nel 2017 dal progetto Parole O_Stili. L’occasione è il Festival della Comunicazione non Ostile, tenuto il 21 e il 22 febbraio a Trieste in collaborazione con l’Università di Urbino.

I dieci princìpi

Giovanni Boccia Artieri, professore ordinario di Sociologia dei processi culturali e comunicativi dell’Uniurb, ha guidato trenta ragazze e ragazzi in due giornate di formazione. Divisi in gruppi, hanno declinato i princìpi del Manifesto originario con l’aiuto dell’intelligenza artificiale. Boccia Artieri ne evidenzia alcuni aspetti. In primis la consapevolezza della responsabilità che si ha quando si interagisce con l’IA, che attraverso i nostri dialoghi alimenta il suo sapere. C’è poi lo spirito critico che bisogna esercitare per tutelarci da contenuti falsi e dalla disinformazione. Il professore sottolinea poi una chiave positiva: l’IA ci aiuta a comunicare meglio e a trovare le parole giuste per sostenere un dialogo in maniera chiara, rispettosa e costruttiva.

Il professore suggerisce di non utilizzare questi chatbot come motori di ricerca a cui porre domande, ma tessere con loro un dialogo. Lo stesso che le ragazze e ragazzi dell’H-Farm hanno avuto con i vari bot per scrivere il Manifesto. Boccia Artieri paragona l’IA a uno strumento da mettere nell’astuccio, da tirare fuori all’occorrenza, come fosse un goniometro, “perché serve per fare qualcosa”. Un manifesto che ha come obiettivi sdoganare l’uso dell’IA, non nascondere il suo utilizzo e fornire una guida etica per farlo. “Verrà inviato un po’ dappertutto – chiude il professore – le scuole potranno stamparlo e affiggerlo all’interno delle aule. Anche le imprese potranno diffonderlo tra i loro dipendenti”.

La voce degli studenti

All’H-Farm l’intelligenza artificiale la utilizzano tutti i giorni. “Ci supporta nello studio, come fosse un tutor”, spiega Elena Barbieri Ripamonti, in diretta dal Festival su Eta Beta di Radio1 Rai. La studentessa pone l’attenzione su due princìpi, il primo e l’ultimo: “Virtuale è reale” e “Anche il silenzio comunica”.

“Non ci rendiamo conto che ciò che diamo all’IA poi viene restituito a qualcun altro. L’intelligenza artificiale siamo noi”, afferma Elena. Proprio come una bambina, più le riversiamo parole buone, meglio viene educata . Anche alcuni studi suggeriscono di “trattarla bene”, come fosse una persona, “dandole il buongiorno e ringraziandola”. Allo stesso tempo, evidenzia Elena, non comunichiamo solo con le parole. “L’invito che vogliamo fare è valutare sempre se è il caso di parlare”, capire quando interagire con l’IA e quando invece preferire la riflessione personale alle sue scorciatoie.